分子シミュレーション&インフォマティクス 用語解説

Transformer [とらんすふぉーまー] [Transformer]

Transformer は、自然言語処理を中心とした深層学習モデルで用いられるアーキテクチャであり、2017年に発表された「Attention Is All You Need」によって提案された。特徴は、従来の RNN や CNN のような再帰処理や畳み込みを用いず、自己注意機構(Self-Attention)を中心に系列データの依存関係を捉える点にある。自己注意機構は、入力系列内の要素同士の関連度を計算し、文脈上重要な情報に重点を置いて処理できるため、長文でも効率よく全体構造を把握できる。この仕組みにより、Transformer は並列計算に適し、大規模データを用いた学習にも高いスケーラビリティを持つ。

Transformer は生成 AI の中核技術として急速に普及し、特に GPT 系モデルの基盤となっている。GPT シリーズはモデル規模と学習データを大幅に拡張することで性能を向上させ、文脈理解、文章生成、要約、翻訳など多様なタスクで高い汎化能力を示す。大規模化によって精度が向上するという特性は、Transformer の構造的な強みを示しており、現代の生成 AI を支える不可欠な技術となっている。

- 製品情報

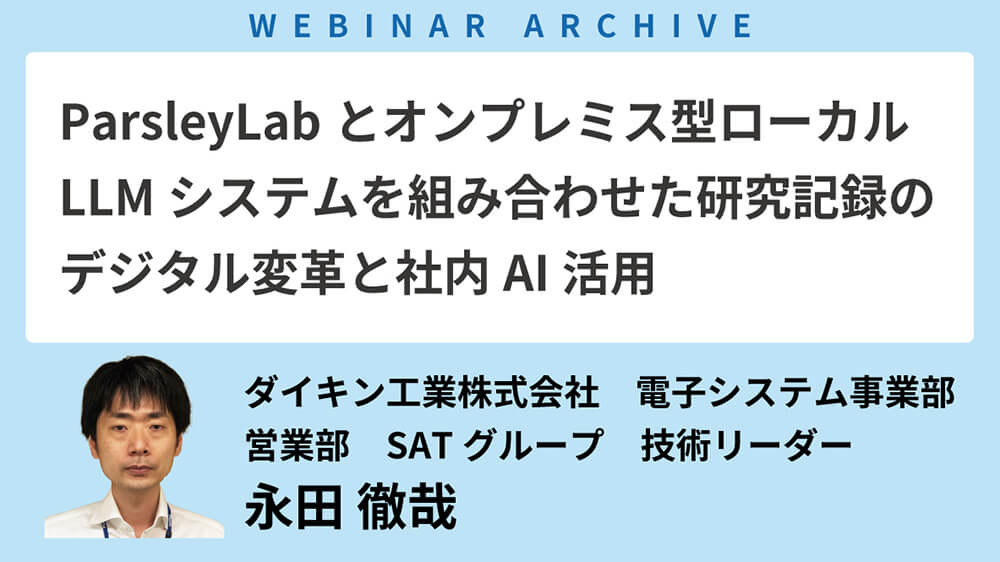

ParsleyLab:Excel形式で柔軟に記録しつつ、組織内で簡単かつ自由にデータを蓄積・活用できるソリューション